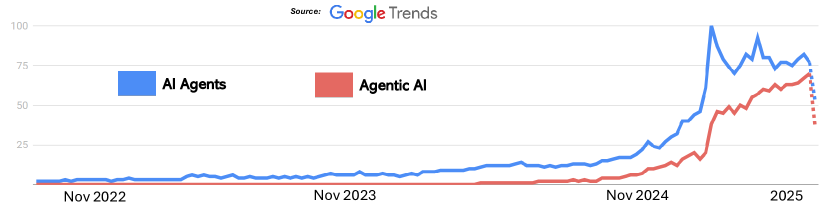

Spätestens seit dem Durchbruch von ChatGPT Ende 2022 sprechen alle über KI. Aber die Entwicklung geht rasend schnell weiter. Über die reinen Sprachmodelle (LLMs) hinaus entstehen zunehmend autonome Systeme, die mehr können als nur auf Prompts zu reagieren: AI Agents und Agentic AI.

Doch was genau steckt hinter diesen Begriffen? Sind das nur neue Buzzwords, oder markieren sie wirklich den nächsten Schritt in der Evolution der Künstlichen Intelligenz? Dieser Artikel bringt Licht ins Dunkel, erklärt die fundamentalen Unterschiede, zeigt dir, wo diese Systeme schon heute eingesetzt werden und welche Hürden noch zu nehmen sind. Mach dich bereit für einen tiefen Tauchgang in die Zukunft der intelligenten Automatisierung!

Du suchst noch mehr Infos über AI Agents – dann schaue doch mal in den AI Index Report 2025!

Das Wichtigste in Kürze – AI Agents vs. Agentic AI

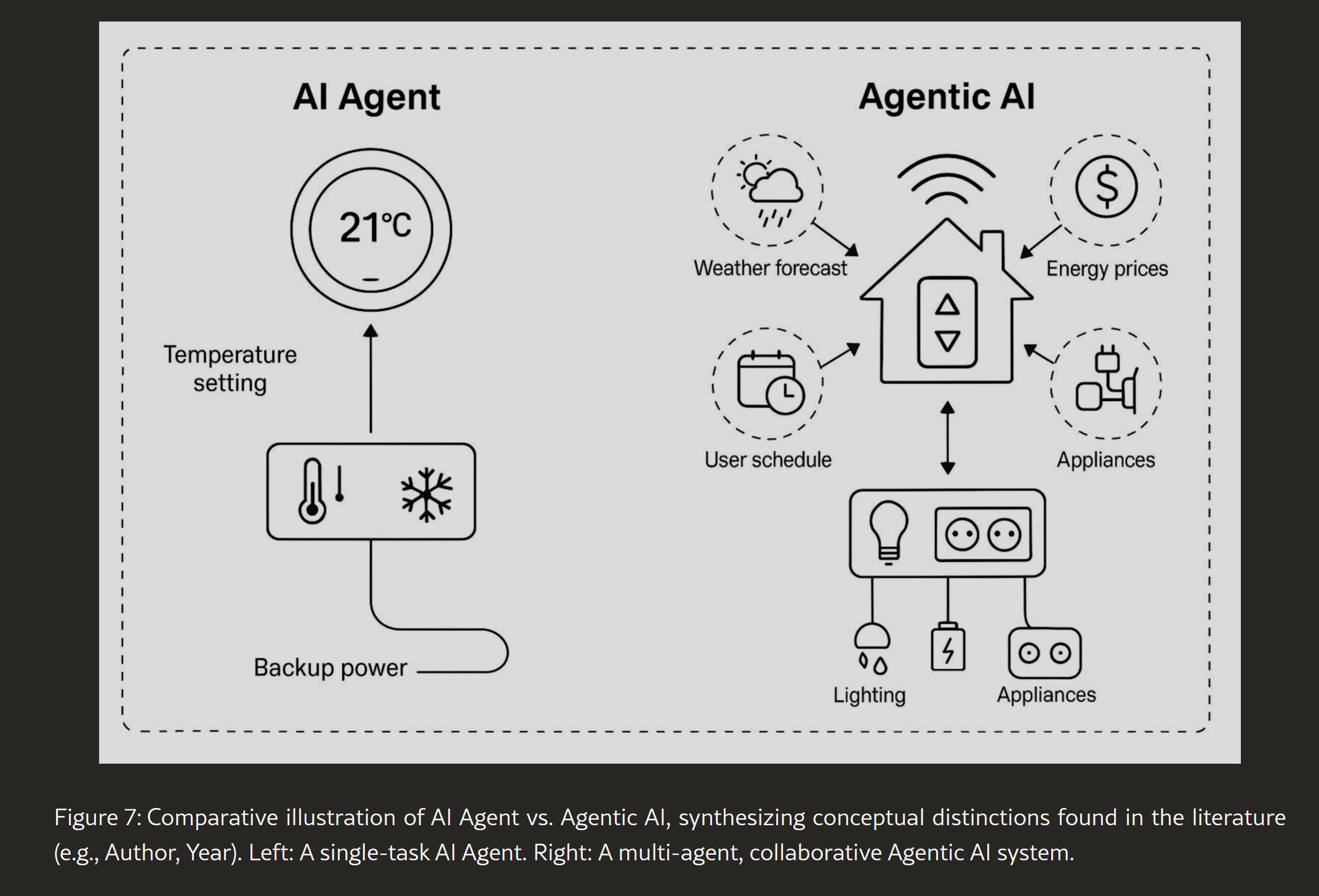

- AI Agents sind eigenständige KI-Systeme für spezifische, klar definierte Aufgaben, oft erweitert durch die Nutzung externer Tools und APIs.

- Agentic AI bezeichnet kollaborative Systeme aus mehreren AI Agents, die dynamisch zusammenarbeiten, Aufgaben zerlegen und koordinieren, um komplexe, übergeordnete Ziele zu erreichen.

- Während AI Agents reaktiv auf Eingaben agieren und begrenzte Autonomie haben, zeichnet sich Agentic AI durch proaktive Planung, persistente Erinnerung und systemweite Koordination aus.

- Anwendungsbereiche reichen von Kunden-Support (AI Agents) bis zur automatisierten Forschung oder Roboter-Koordination (Agentic AI).

- Herausforderungen liegen in der Kausalität (mangelndes Ursache-Wirkungs-Verständnis), Zuverlässigkeit (Halluzinationen, Fehlerkaskaden) und der sicheren Koordination komplexer Multi-Agenten-Systeme.

Von Generativer KI zu intelligenten Agenten: Eine Evolution

Bevor wir die Unterschiede zwischen AI Agents und Agentic AI beleuchten, lass uns kurz zurückblicken. Die KI-Landschaft vor 2022, also vor der flächendeckenden Verbreitung von Modellen wie ChatGPT, war geprägt von Systemen mit fest definierten Regeln und begrenzter Anpassungsfähigkeit. Expertensysteme, regelbasierte Robotik oder Skript-gesteuerte NPCs in Spielen – all das waren Vorläufer, die ihre Aufgaben oft nur in engen, vordefinierten Umgebungen lösen konnten. Sie waren reaktiv und starr, weit entfernt von echtem Lernen oder kontextuellem Verständnis.

Mit dem Aufkommen der großen generativen Modelle wie LLMs (Large Language Models) und LIMs (Large Image Models) Ende 2022 änderte sich das radikal. Plötzlich waren KI-Systeme in der Lage, aus Text-Prompts heraus völlig neue Inhalte zu erschaffen: kohärente Texte, realistische Bilder, funktionierenden Code. Modelle wie GPT-4, PaLM oder Midjourney revolutionierten kreative und produktive Prozesse.

Doch auch diese generative KI hatte eine fundamentale Einschränkung: Sie war und ist reaktiv. Du gibst einen Prompt ein, das Modell generiert eine Ausgabe. Punkt. Es hat kein eigenes Ziel, keine Erinnerung über die aktuelle Sitzung hinaus (ohne Tricks) und kann nicht selbstständig Werkzeuge nutzen oder komplexe, mehrstufige Pläne verfolgen. Diese Einschränkungen führten zur nächsten Evolutionsstufe: den AI Agents.

Was sind AI Agents? Deine spezialisierten KI-Helfer

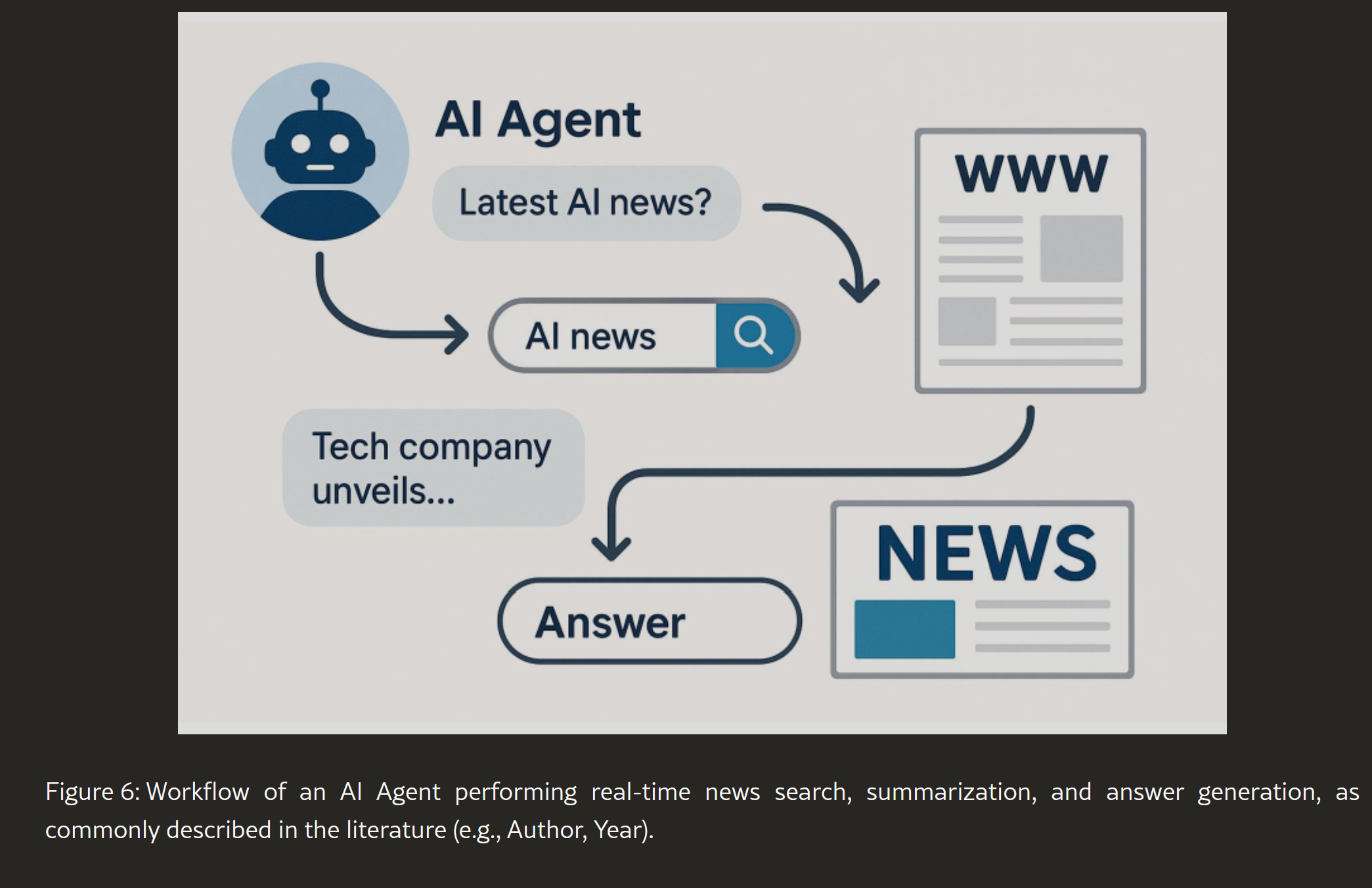

Stell dir einen AI Agent wie einen fleißigen digitalen Assistenten vor, der eine spezifische Aufgabe für dich erledigt. Diese Systeme bauen auf der generativen Fähigkeit von LLMs auf, erweitern diese aber entscheidend: Sie können externe Werkzeuge nutzen und einfache Pläne verfolgen, um ein definiertes Ziel zu erreichen.

Kernmerkmale von AI Agents

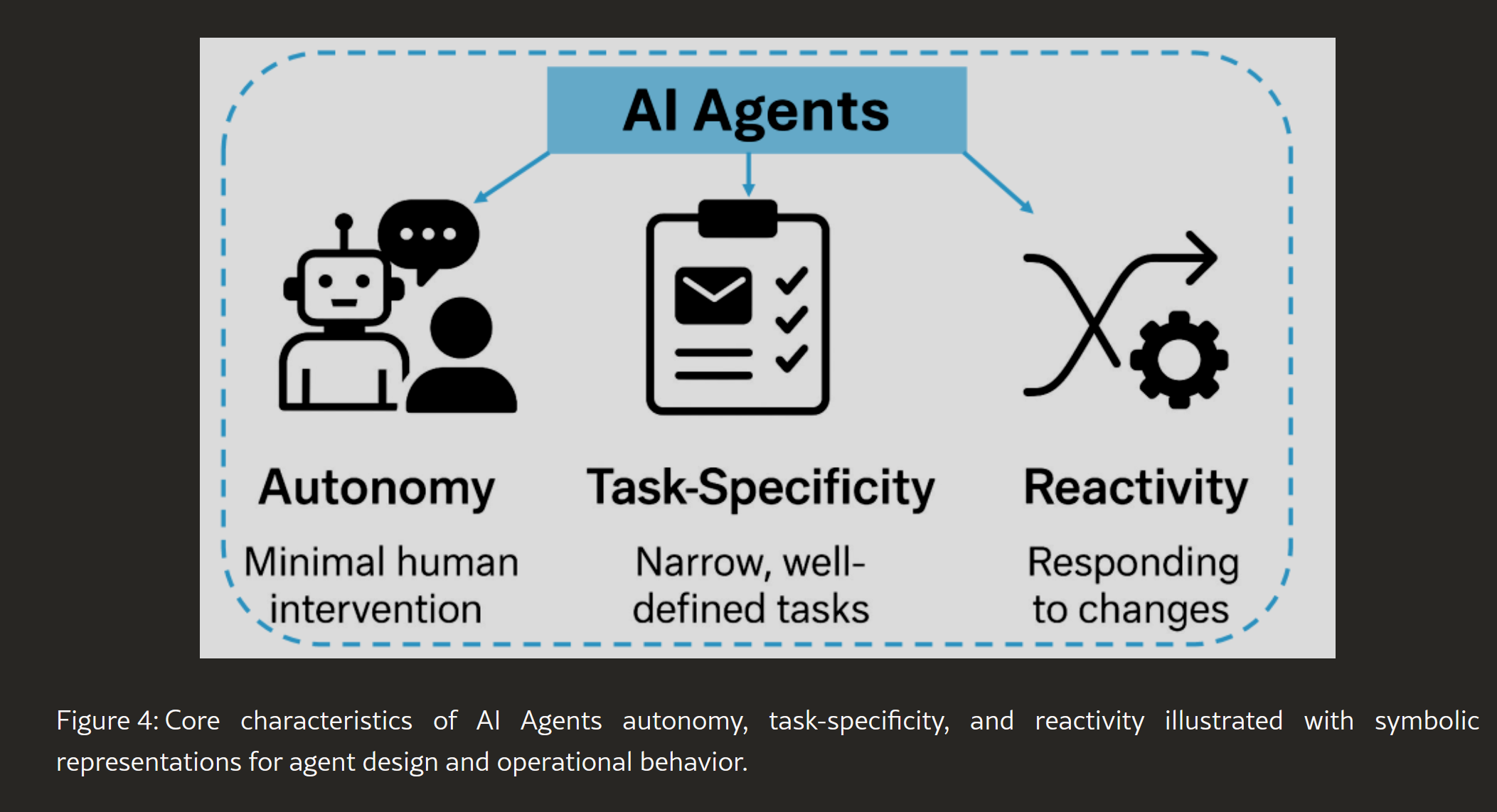

Das Papier von Sapkota et al. identifiziert drei grundlegende Eigenschaften, die AI Agents definieren:

- Autonomie (innerhalb ihrer Aufgabe): Einmal initialisiert, können AI Agents relativ eigenständig agieren, Eingaben verarbeiten, Entscheidungen treffen (innerhalb ihres Aufgabenbereichs) und Aktionen ausführen, oft ohne ständige menschliche Aufsicht.

- Aufgabenspezifität: Sie sind für eng definierte Aufgaben konzipiert. Denk an einen Agenten, der nur E-Mails filtert, einen anderen, der nur Datenbanken abfragt, oder einen dritten, der nur Kalendereinträge koordiniert. Diese Spezialisierung ermöglicht hohe Effizienz in ihrem Bereich.

- Reaktivität mit Anpassung: Sie reagieren auf Veränderungen in ihrer Umgebung, sei es eine neue Nutzeranfrage, eine API-Antwort oder eine Statusänderung. Einige können sich durch einfache Feedback-Schleifen oder die Nutzung von Kontext anpassen und ihr Verhalten leicht verfeinern.

Im Gegensatz zu reiner generativer KI, die einfach nur Output erzeugt, sind AI Agents in der Lage zu handeln. Sie können APIs aufrufen, im Web suchen, Skripte ausführen oder mit anderer Software interagieren.

Schlüsselunterschiede zwischen AI Agents vs. Agentic AI

Die Studie identifiziert klare Unterschiede, die AI Agents von Agentic AI abgrenzen und ihre Position auf dem Weg zu wirklich autonomen Systemen definieren. Hier die wichtigsten Merkmale im Überblick:

| Merkmal | AI Agents | Agentic AI |

|---|---|---|

| Definition | Autonome Softwareprogramme für spezifische Aufgaben. | Systeme aus mehreren AI Agents, die zur Erreichung komplexer Ziele zusammenarbeiten. |

| Autonomie-Level | Hohe Autonomie innerhalb spezifischer Aufgaben. | Höhere Autonomie mit der Fähigkeit, mehrstufige, komplexe Aufgaben zu verwalten. |

| Aufgaben-Komp. | Handhaben typischerweise einzelne, spezifische Aufgaben. | Handhaben komplexe, mehrstufige Aufgaben, die Koordination erfordern. |

| Kollaboration | Operieren unabhängig. | Beziehen die Kollaboration und den Informationsaustausch mehrerer Agenten ein. |

| Lernen & Anp. | Lernen und passen sich innerhalb ihres spezifischen Bereichs an. | Lernen und passen sich über einen breiteren Bereich von Aufgaben und Umgebungen hinweg an. |

| Anwendungen | Kunden-Support-Chatbots, virtuelle Assistenten, automatisierte Workflows. | Lieferkettenmanagement, Optimierung von Geschäftsprozessen, virtuelle Projektmanager. |

KI-Agenten-Paradigmen im Vergleich: Konzepte und Kognition

Um die Entwicklung und die feineren Unterschiede zwischen reiner Generativer KI, AI Agents, Agentic AI und dem Konzept des „Generativen Agenten“ (der oft eine Brücke schlägt) noch klarer zu machen, werfen wir einen Blick auf ihre konzeptuellen und kognitiven Dimensionen. Diese Tabelle, abgeleitet aus der Forschung, zeigt dir auf einen Blick, wie sich diese Paradigmen in Bezug auf ihre Initiierung, Zielflexibilität, Speicher und mehr unterscheiden:

| Konzeptuelle Dimension | Generative KI | AI Agent | Agentic AI | Generativer Agent (abgeleitet) |

|---|---|---|---|---|

| Initiierungstyp | Prompt-gesteuert (Nutzer/Input) | Prompt- oder Ziel-gesteuert (mit Tool) | Ziel-initiiert oder orchestrierte Aufgabe | Prompt- oder System-Level-Trigger |

| Ziel-Flexibilität | (Keine) Fest pro Prompt | (Gering) Führt spezifisches Ziel aus | (Hoch) Zerlegt und passt Ziele dynamisch an | (Gering) Gesteuert durch Subtask-Ziel |

| Temporale Kontin. | Zustandslos, Einzelsitzungs-Output | Kurzeitkontinuität innerhalb der Aufgabe | Persistent über Workflow-Stufen hinweg | Kontext-begrenzt auf Subtask |

| Lernen/Anpassung | Statisch (vortrainiert) | (Vielleicht zukünftig) Tool-Auswahl passt sich an | (Ja) Lernt aus Ergebnissen | Typischerweise statisch; begrenzte Anpassung |

| Speicher-Nutzung | Kein Speicher/kurzes Kontext-Fenster | Optionaler Speicher oder Tool-Cache | Geteilter episodischer/aufgabenbezogener Speicher | Subtask-lokaler oder kontextueller Speicher |

| Koordinationsstr. | Keine (Einzelschritt-Prozess) | Isolierte Aufgabenausführung | Hierarchische oder dezentrale Koordination | Erhält Anweisungen vom System |

| Systemrolle | Inhaltserzeuger | Tool-nutzender Aufgabenausführer | Orchestrator kollaborativer Workflows | Modularer Erzeuger auf Subtask-Ebene |

LLMs und LIMs als „Gehirn“ der AI Agents

Die Fähigkeit von AI Agents zu „denken“ und „verstehen“ basiert stark auf großen Basismodellen. LLMs wie GPT-4, Claude oder LLaMA dienen als ihr zentrales Denkmodul. Sie interpretieren Nutzeranfragen, verstehen den Kontext, entwickeln einfache „Gedankenketten“ (oft durch spezifisches Prompting wie Chain-of-Thought) und entscheiden, welche Werkzeuge sie nutzen müssen.

LIMs (Large Image Models) wie CLIP oder BLIP-2 erweitern diese Fähigkeiten um die visuelle Wahrnehmung. Ein AI Agent, der Drohnen steuert (wie in der Studie als Beispiel genannt), nutzt LIMs, um Bilder zu analysieren, Objekte zu erkennen (z.B. kranke Pflanzen, beschädigte Äste) und darauf basierend Entscheidungen zu treffen und Aktionen auszulösen – etwa einen Gärtner benachrichtigen oder die Stelle für eine gezielte Behandlung markieren.

So funktioniert ein AI Agent: Der ReAct-Loop im Detail

Viele moderne AI Agents nutzen ein Muster wie den sogenannten ReAct-Loop (Reasoning and Acting), um zielgerichtet zu agieren. Das ist quasi eine Mini-Anleitung für den Agenten:

- Reason (Nachdenken): Der Agent erhält eine Aufgabe oder eine Eingabe. Das LLM überlegt (simuliert durch internes Prompting), was zu tun ist, welche Schritte nötig sind und welche Tools hilfreich sein könnten. Es formuliert einen Plan oder den nächsten logischen Schritt.

- Act (Handeln): Basierend auf dem Plan wählt der Agent ein passendes externes Werkzeug (z.B. eine Such-API, einen Kalender-Service, einen Python-Interpreter) und führt eine Aktion aus.

- Observe (Beobachten): Der Agent empfängt das Ergebnis der Aktion (z.B. die Suchergebnisse, die Kalenderbestätigung, das Ergebnis der Code-Ausführung).

- Loop: Mit der neuen Information (der Beobachtung) geht der Agent zurück zu Schritt 1 (Reason), um den nächsten Schritt zu planen, den ursprünglichen Plan anzupassen oder festzustellen, dass das Ziel erreicht ist.

Dieser iterative Prozess erlaubt AI Agents, dynamisch auf die Welt zu reagieren und Aufgaben zu lösen, die über eine einzelne Prompt-Antwort hinausgehen.

Agentic AI: Das Orchester der intelligenten Agenten

AI Agents sind also spezialisierte Werkzeugmeister. Aber was passiert, wenn die Aufgabe zu komplex wird für einen einzelnen Agenten? Wenn sie eine übergreifende Koordination, geteilte Informationen und dynamische Rollenverteilung erfordert? Genau hier setzt Agentic AI an.

Agentic AI-Systeme sind keine einzelnen Agenten, sondern Kollektive von mehreren, oft spezialisierten AI Agents, die zusammenarbeiten, um ein komplexes, übergeordnetes Ziel zu erreichen. Das ist der konzeptionelle Sprung von einem Solisten (AI Agent) zu einem ganzen Orchester (Agentic AI System).

Wichtige Unterscheidungsmerkmale von Agentic AI

Das Kernkonzept von Agentic AI ist die Zusammenarbeit und Koordination. Die Studie hebt hervor:

- Multi-Agenten-Architektur: Das System besteht aus mehreren unterschiedlichen Agenten, die jeweils eine spezifische Rolle oder Fähigkeit haben (z.B. ein Planungs-Agent, ein Recherche-Agent, ein Synthese-Agent).

- Dynamische Aufgabenzerlegung: Ein übergeordnetes Ziel wird vom System (oft durch einen „Orchestrierungs-Agenten“) automatisch in kleinere, handhabbare Sub-Aufgaben zerlegt.

- Inter-Agenten-Kommunikation: Die Agenten im System können miteinander kommunizieren, Ergebnisse austauschen, Abhängigkeiten klären und ihre Aktionen aufeinander abstimmen. Dies geschieht über definierte Kanäle oder geteilte Speicherbereiche.

- Persistente Erinnerung: Agentic AI-Systeme verfügen oft über ausgeklügelte Speichermechanismen (episodisch für den Workflow-Verlauf, semantisch für Faktenwissen, Vektor-basiert für Retrieval), die es den Agenten ermöglichen, Kontext über längere Zeiträume und Interaktionen hinweg zu teilen und zu nutzen.

- Orchestrierung: Es gibt Mechanismen (oft Metaregeln oder spezifische Orchestrierungs-Agenten), die den gesamten Prozess steuern: Aufgaben zuweisen, den Fortschritt überwachen, Konflikte lösen und die Ergebnisse der einzelnen Agenten zusammenführen.

Zusammenarbeit im Agentic AI System: Ein Beispiel-Workflow

Stell dir vor, das Ziel ist, einen umfassenden Marktbericht über ein neues Produkt zu erstellen. Ein Agentic AI System könnte so vorgehen:

- Orchestrator-Agent: Empfängt das Ziel („Erstelle einen Marktbericht für Produkt X“). Zerlegt die Aufgabe:

- Recherche über Wettbewerber

- Analyse von Zielgruppenfeedback

- Sammeln von Marktdaten

- Synthese der Ergebnisse

- Erstellen eines Entwurfs

- Überprüfung des Entwurfs

- Recherche-Agent: Erhält den Auftrag „Recherche über Wettbewerber“. Nutzt Web-Such-Tools und Firmendatenbank-APIs. Sendet die Ergebnisse an den Orchestrator oder legt sie in einem geteilten Arbeitsbereich ab.

- Analyse-Agent: Erhält den Auftrag „Analyse von Zielgruppenfeedback“. Greift auf Kundenfeedback-Datenbanken zu, nutzt Sentiment-Analyse-Tools. Legt die Ergebnisse ab.

- Daten-Agent: Erhält den Auftrag „Sammeln von Marktdaten“. Nutzt Marktstatistik-APIs. Legt die Daten ab.

- Synthese-Agent: Wenn Recherche-, Analyse- und Daten-Agent fertig sind, erhält der Synthese-Agent den Auftrag, die gesammelten Informationen zusammenzuführen und Kernaussagen zu extrahieren.

- Entwurfs-Agent: Nimmt die Kernaussagen und entwirft den Bericht, formatiert ihn vielleicht basierend auf gespeicherten Vorlagen.

- Review-Agent: Prüft den Entwurf auf Konsistenz, Faktenfehler und Lesbarkeit. Gibt Feedback an den Orchestrator.

- Orchestrator-Agent: Erhält das Feedback, weist den Entwurfs-Agenten (oder einen anderen) an, Überarbeitungen vorzunehmen, bis der Bericht den Qualitätsstandards entspricht.

In diesem Beispiel siehst du, wie spezialisierte Agenten parallel und sequenziell arbeiten, Informationen teilen und vom Orchestrator gesteuert werden, um ein komplexes Ziel zu erreichen, das weit über die Fähigkeiten eines einzelnen AI Agents hinausgeht. Systeme wie AutoGen oder CrewAI arbeiten nach ähnlichen Prinzipien.

Anwendungsbereiche: Wo AI Agents vs. Agentic AI heute schon wirken

Die unterschiedlichen Fähigkeiten führen natürlich auch zu unterschiedlichen Einsatzgebieten.

AI Agents im Einsatz:

- Kunden-Support & interne Suche: Chatbots, die auf häufige Fragen antworten, Bestellungen verfolgen oder Mitarbeitern helfen, schnell relevante interne Dokumente zu finden (z.B. Salesforce Einstein, Intercom Fin, Notion AI).

- E-Mail-Verwaltung: Agenten, die deine Inbox vorsortieren, Prioritäten setzen, Termine extrahieren oder Entwürfe für Antworten vorschlagen (z.B. in Microsoft Outlook, Superhuman).

- Personalisierung & einfache Reports: Systeme, die dein Verhalten analysieren, um dir passende Produkte, Nachrichten oder Musik zu empfehlen (z.B. Amazon, YouTube, Spotify) oder die aus Daten einfache Berichte auf natürliche Sprachbefehle erstellen (z.B. Tableau Pulse, Power BI Copilot).

- Terminplanung: Agenten, die selbstständig Besprechungen koordinieren, Verfügbarkeiten abgleichen und Einladungen versenden (z.B. x.ai, Reclaim AI).

Agentic AI im Einsatz:

- Automatisierte Forschung: Systeme, bei denen Agenten Literatur recherchieren, Paper zusammenfassen, Daten extrahieren und erste Entwürfe für wissenschaftliche Artikel oder Grant-Anträge erstellen (z.B. AutoGen-Pipelines).

- Roboter-Koordination: Schwärme von Drohnen oder Lagerrobotern, die Aufgaben dynamisch unter sich aufteilen, ihre Routen in Echtzeit anpassen und gemeinsam ein Ziel verfolgen – etwa das Inspizieren eines großen Feldes oder die Optimierung von Lagerabläufen. Die Studie nennt hier Beispiele aus der Landwirtschaft (Apfelernte) und Logistik.

- Kollaborative Medizin: Agenten-Systeme, die in Kliniken unterschiedliche Aufgaben übernehmen – einer überwacht Vitaldaten, ein anderer analysiert die Patientenakte, ein dritter gleicht Symptome mit Diagnoserichtlinien ab. Sie arbeiten zusammen, um Ärzten fundierte Entscheidungshilfen zu geben, zum Beispiel auf Intensivstationen.

- Komplexe Workflow-Automatisierung & Game AI: Systeme, die in Unternehmen komplexe Prozesse (z.B. IT-Sicherheitsvorfälle, Rechtsprüfung) über verschiedene Software hinweg automatisieren und koordinieren oder die in Spielen für realistisches, emergentes Verhalten von Nicht-Spieler-Charakteren sorgen.

Hier siehst du: AI Agents sind oft nützliche, aber abgeschlossene Werkzeuge für spezifische Aufgaben. Agentic AI hingegen ermöglicht die Automatisierung und Koordination von mehrstufigen Prozessen, die eine intelligente Zusammenarbeit erfordern.

Herausforderungen: Stolpersteine auf dem Weg zur vollen Autonomie

Bei aller Begeisterung sind AI Agents vs. Agentic AI noch lange nicht perfekt. Die Studie identifiziert eine Reihe signifikanter Herausforderungen für beide Paradigmen.

Herausforderungen bei AI Agents:

- Mangelndes Kausalverständnis: LLMs basieren auf Korrelation, nicht Kausalität. Ein Agent weiß oft nicht, warum etwas passiert oder was die Folge einer bestimmten Handlung ist, sondern nur, dass X oft mit Y zusammen auftritt. Das macht sie anfällig für Fehler in neuen Situationen.

- Begrenzungen von LLMs: Sie erben Probleme der zugrundeliegenden Modelle: Halluzinationen (frei erfundene, aber plausibel klingende Informationen), Anfälligkeit für kleine Änderungen im Prompt (Brittleness) und oft oberflächliches „Denken“, auch bei fortgeschrittenen Methoden wie Chain-of-Thought.

- Unvollständige Agenten-Eigenschaften: Viele als „Agenten“ bezeichnete Systeme erfüllen die theoretischen Kriterien (volle Autonomie, Proaktivität, soziale Fähigkeit) nur teilweise. Sie sind immer noch oft reaktiv und benötigen viel menschliches „Gerüst“ (Scaffolding).

- Schwäche bei Langzeitplanung: AI Agents tun sich schwer mit Aufgaben, die viele Schritte über einen längeren Zeitraum erfordern oder bei denen Pläne dynamisch angepasst werden müssen, wenn etwas schiefgeht.

Zusätzliche und verstärkte Herausforderungen bei Agentic AI:

Die Probleme von einzelnen Agenten werden in Multi-Agenten-Systemen oft noch verschärft:

- Verstärkte Kausalitäts-Probleme: Wenn Agenten interagieren, können mangelndes Kausalverständnis und Fehler eines Agenten eine Kaskade von Fehlern im ganzen System auslösen.

- Kommunikations- & Koordinationsengpässe: Agenten müssen ein gemeinsames Verständnis des Ziels haben und effizient kommunizieren. Das Fehlen standardisierter Protokolle und die Schwierigkeit, Kontext über Agenten hinweg zu teilen, sind große Hürden.

- Emergentes Verhalten & Unvorhersehbarkeit: Wenn viele autonome Agenten interagieren, können unerwartete Systemverhaltensweisen auftreten – nicht immer im positiven Sinne. Das macht Agentic AI potenziell schwer vorhersehbar, zu kontrollieren und sicher zu gestalten.

- Skalierbarkeit & Debugging: Mit der Anzahl der Agenten und ihrer Interaktionen explodiert die Komplexität. Es wird extrem schwer, nachzuvollziehen, warum ein Fehler aufgetreten ist oder wie eine bestimmte Entscheidung zustande kam („Black-Box“-Problem).

- Vertrauen, Erklärbarkeit & Verifikation: Es ist schwierig zu verstehen, wie Agentic AI-Systeme zu ihren Ergebnissen kommen (Erklärbarkeit) und noch schwieriger zu beweisen, dass sie in allen Situationen zuverlässig und sicher agieren werden (Verifikation). Das ist ein riesiges Problem für den Einsatz in kritischen Bereichen.

- Sicherheit & Angriffsfläche: Ein Multi-Agenten-System hat eine viel größere Angriffsfläche. Wenn ein Agent kompromittiert wird, kann das ganze System infiziert oder manipuliert werden.

- Ethische & Governance-Fragen: Wer ist verantwortlich, wenn ein autonomes Agentic AI System einen Fehler macht? Wie stellt man sicher, dass Bias nicht durch die Interaktion der Agenten verstärkt wird? Wie richtet man die Ziele der Agenten auf menschliche Werte aus?

Lösungen & der Blick nach vorn: Die Roadmap für intelligente Systeme

Die gute Nachricht: Die Forschung arbeitet intensiv an diesen Herausforderungen. Die Studie skizziert potenzielle Lösungsansätze und eine Roadmap für die Zukunft:

- Retrieval-Augmented Generation (RAG): Um Halluzinationen zu reduzieren und Wissen aktuell zu halten, können Agenten externe Wissensquellen (Datenbanken, Dokumente, Web) in ihre Entscheidungen einbeziehen. Besonders wichtig für Agentic AI, um ein „gemeinsames Wahrheitsverständnis“ unter den Agenten zu schaffen.

- Tool-Augmented Reasoning: Die Fähigkeit, externe Werkzeuge sicher und intelligent zu nutzen, ist entscheidend. Verbessertes Function Calling ermöglicht Agenten, dynamisch mit der digitalen Welt zu interagieren.

- Verbesserte Agenten-Loops (ReAct & Co.): Iterative Denk-Handlungs-Beobachtungs-Schleifen machen Agenten robuster und kontextsensitiver. In Agentic AI müssen diese Schleifen agentenübergreifend synchronisiert werden.

- Ausgefeilte Speicherarchitekturen: Agenten brauchen besseres Gedächtnis – episodisch (Was ist bisher passiert?), semantisch (Faktenwissen) und Vektor-basiert (für RAG). Agentic AI benötigt geteilte Speicher, auf die alle relevanten Agenten zugreifen können.

- Orchestrierung & Rollenspezialisierung: Klare Rollen für Agenten (Planer, Rechercheur etc.) und ein übergeordneter Orchestrator, der die Zusammenarbeit steuert, sind entscheidend für Agentic AI-Systeme.

- Reflexion & Selbstkritik: Agenten sollten ihre eigenen Ausgaben und Handlungen überprüfen können. In Agentic AI können Agenten auch die Arbeit anderer Agenten prüfen – ein wichtiger Qualitätsmechanismus.

- Programmatisches Prompt Engineering: Statt manueller Prompt-Anpassung werden Prompts dynamisch und strukturiert generiert, um Agenten stabiler und die Kommunikation zwischen Agenten klarer zu machen.

- Kausales Modellieren & Simulationsplanung: Agenten müssen Ursache und Wirkung verstehen lernen. In Agentic AI wird Simulationsplanung wichtig, damit Agenten-Kollektive mögliche Szenarien durchspielen und die Folgen ihrer Handlungen abschätzen können.

- Monitoring, Auditing & Erklärbarkeit: Werkzeuge zur Nachverfolgung der Agenten-Aktionen (Logs) sind essenziell, um Fehler zu finden und das Systemverhalten zu verstehen, besonders in komplexen Agentic AI-Systemen.

- Governance-aware Architekturen: Systeme müssen von Grund auf mit Blick auf Sicherheit, Fairness und Verantwortlichkeit entworfen werden. Rollenbasierte Zugriffe und klare Zurechenbarkeit von Entscheidungen sind hier wichtig.

Die Zukunftsvision:

Die Studie sieht eine Zukunft, in der sich AI Agents zu proaktiveren, kausal denkenden und lernfähigen Systemen entwickeln, die nahtlos Werkzeuge integrieren und vertrauenswürdiger werden.

Agentic AI wird sich parallel dazu zu skalierbaren, orchestrierten Multi-Agenten-Systemen entwickeln, die über persistente Erinnerung verfügen, komplexe Simulationen durchführen können, robuste ethische Rahmenwerke integrieren und hochspezialisiert für Domänen wie Medizin oder Recht eingesetzt werden. Es geht hin zu kollaborativer Maschinenintelligenz, die plant, denkt und sich abstimmt, ähnlich wie ein menschliches Team.

Häufig gestellte Fragen – AI Agents vs. Agentic AI

Was ist der Hauptunterschied zwischen AI Agents und Agentic AI? Der Hauptunterschied liegt in der Komposition und Komplexität. AI Agents sind einzelne, spezialisierte Systeme für spezifische Aufgaben. Agentic AI sind Systeme aus mehreren AI Agents, die zusammenarbeiten und koordiniert werden, um komplexe, übergeordnete Ziele zu erreichen.

Welche Rolle spielen LLMs bei diesen Systemen? LLMs (und LIMs) dienen als das „Gehirn“ oder die „Denkmaschine“. Sie ermöglichen AI Agents, Sprache zu verstehen, zu „schließen“ und Entscheidungen zu treffen. In Agentic AI-Systemen sind sie die kognitiven Komponenten der einzelnen Agenten.

Können AI Agents wirklich autonom handeln? AI Agents haben Autonomie innerhalb ihres definierten Aufgabenbereichs, oft durch die Fähigkeit, Werkzeuge selbstständig zu nutzen. Volle Autonomie im Sinne von selbstständiger Zielsetzung oder dynamischer, langfristiger Planung wie bei Agentic AI ist bei einzelnen AI Agents jedoch begrenzt.

Sind Agentic AI Systeme schon im praktischen Einsatz? Ja, erste Frameworks und Systeme wie AutoGen oder CrewAI demonstrieren bereits die Prinzipien von Agentic AI in Bereichen wie automatisierter Forschung oder Softwareentwicklung. Die breite, zuverlässige Anwendung in sehr kritischen Sektoren steht aber noch am Anfang.

Was sind die größten Risiken bei Agentic AI? Zu den größten Risiken gehören die Schwierigkeit, emergentem (unvorhersehbarem) Verhalten zu begegnen, die Komplexität der Fehlerbehebung in verteilten Systemen, Sicherheitslücken durch die Interaktion mehrerer Agenten und grundlegende Fragen der Verantwortlichkeit und Fairness.

Fazit AI Agents vs. Agentic AI: Der Weg zur kollaborativen KI ist geebnet

Die Unterscheidung zwischen AI Agents vs. Agentic AI ist mehr als nur akademische Haarspalterei. Sie beschreibt zwei aufeinander aufbauende Stufen der KI-Entwicklung, jede mit eigenen Fähigkeiten, Anwendungsbereichen und Herausforderungen.

AI Agents sind die logische Weiterentwicklung generativer Modelle: Sie können durch die Nutzung von Werkzeugen und einfache Planungsmechanismen spezifische, klar umrissene Aufgaben autonom erledigen. Sie sind deine digitalen Helfer für Routineaufgaben, Information Retrieval oder einfache Automatisierungen.

Agentic AI repräsentiert den nächsten, signifikanten Schritt: die Orchestrierung mehrerer Agenten, die kollaborativ und dynamisch komplexe Ziele verfolgen. Hier sehen wir das Potenzial für Systeme, die ganze Workflows automatisieren, autonome Robotik-Schwärme steuern oder in hochkomplexen Bereichen wie Medizin und Forschung unterstützen. Es ist der Übergang von der spezialisierten Automatisierung zur echten, team-basierten intelligenten Koordination.

Die Herausforderungen – von mangelndem Kausalverständnis über Zuverlässigkeit bis hin zu ethischen Fragen – sind signifikant. Doch die skizzierten Lösungsansätze zeigen, dass die Forschung auf dem richtigen Weg ist. Verbesserte Architekturen, ausgefeiltere Gedächtnissysteme, robustere Koordinationsmechanismen und vor allem die Integration von Kausalitätsmodellen und Sicherheitsstandards werden entscheidend sein.

Wir stehen am Beginn einer Ära, in der KI-Systeme nicht mehr nur isoliert Code schreiben oder Bilder generieren, sondern proaktiv denken, Werkzeuge nutzen und – im Falle von Agentic AI – intelligent im Team zusammenarbeiten. Diese Entwicklung wird die Art und Weise, wie wir arbeiten, forschen und mit Technologie interagieren, grundlegend verändern. Es ist ein faszinierender Weg, der vor uns liegt – mit enormem Potenzial, aber auch der Notwendigkeit, die Technologie verantwortungsvoll zu gestalten. Bleib dran, denn die nächste Stufe der KI-Evolution entfaltet sich gerade jetzt.

www.KINEWS24-academy.de – KI. Direkt. Verständlich. Anwendbar.

Quellen

#KI #AI #AgenticAI #AIAgents #KuenstlicheIntelligenz #MultiAgentenSysteme #KIZukunft #LLMAgenten