Am 5. Februar 2025 hat Google DeepMind die nächste Generation seiner Gemini-Modelle vorgestellt: Gemini 2.0. Diese umfasst die Modelle Flash, Pro und Flash-Lite. Sie sind ab sofort für Entwickler und fortgeschrittene Nutzer verfügbar sind. Mit diesen Updates möchte Google die Möglichkeiten der künstlichen Intelligenz erweitern und Entwicklern noch leistungsfähigere Werkzeuge an die Hand geben. Die neuen Modelle zeichnen sich durch verbesserte Leistung, höhere Effizienz und eine größere Vielfalt an Anwendungsbereichen aus. Wir beleuchten die Details der neuen Modelle, ihre Funktionen und wie du sie optimal nutzen kannst.

Das musst Du wissen – Gemini 2.0: Flash, Pro und Flash-Lite

- Gemini 2.0 Flash: Allgemein verfügbar, höhere Rate Limits, stärkere Performance und einfachere Preise.

- Gemini 2.0 Flash-Lite: Eine neue Variante, die kosteneffizienteste Modell ist.

- Gemini 2.0 Pro: Ein experimentelles Update des besten Modells für Coding und komplexe Prompts.

- Gemini 2.0 Flash Thinking Experimental: Nutzt Geschwindigkeit mit der Fähigkeit, komplexere Probleme zu lösen.

Welche neuen Funktionen und Möglichkeiten bietet Gemini 2.0?

Folgefragen (FAQs)

- Was ist der Unterschied zwischen Gemini 2.0 Flash, Pro und Flash-Lite?

- Für welche Anwendungsfälle sind die einzelnen Modelle am besten geeignet?

- Wie hoch sind die Kosten für die Nutzung der verschiedenen Gemini 2.0 Modelle?

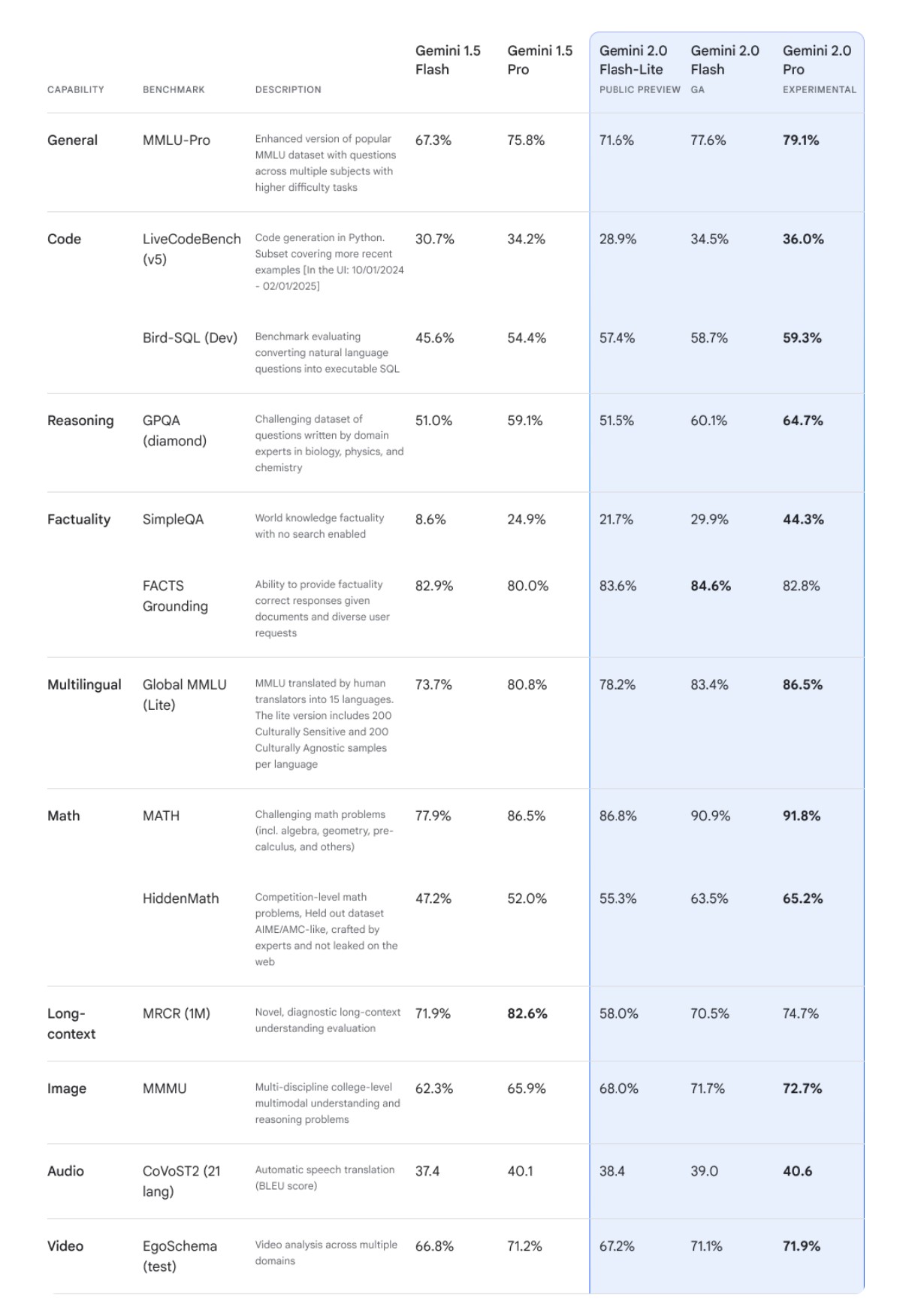

- Welche Verbesserungen bieten die neuen Modelle im Vergleich zu Gemini 1.5?

- Wie kann ich Gemini 2.0 in meine Projekte integrieren?

- Welche Sicherheitsmaßnahmen wurden implementiert, um die sichere Nutzung von Gemini 2.0 zu gewährleisten?

- Welche zukünftigen Entwicklungen und Updates sind für die Gemini 2.0 Familie geplant?

- Wie kann ich das Modell dazu bringen, einen ausführlicheren Schreibstil zu verwenden?

Antworten auf jede Frage

Was ist der Unterschied zwischen Gemini 2.0 Flash, Pro und Flash-Lite?

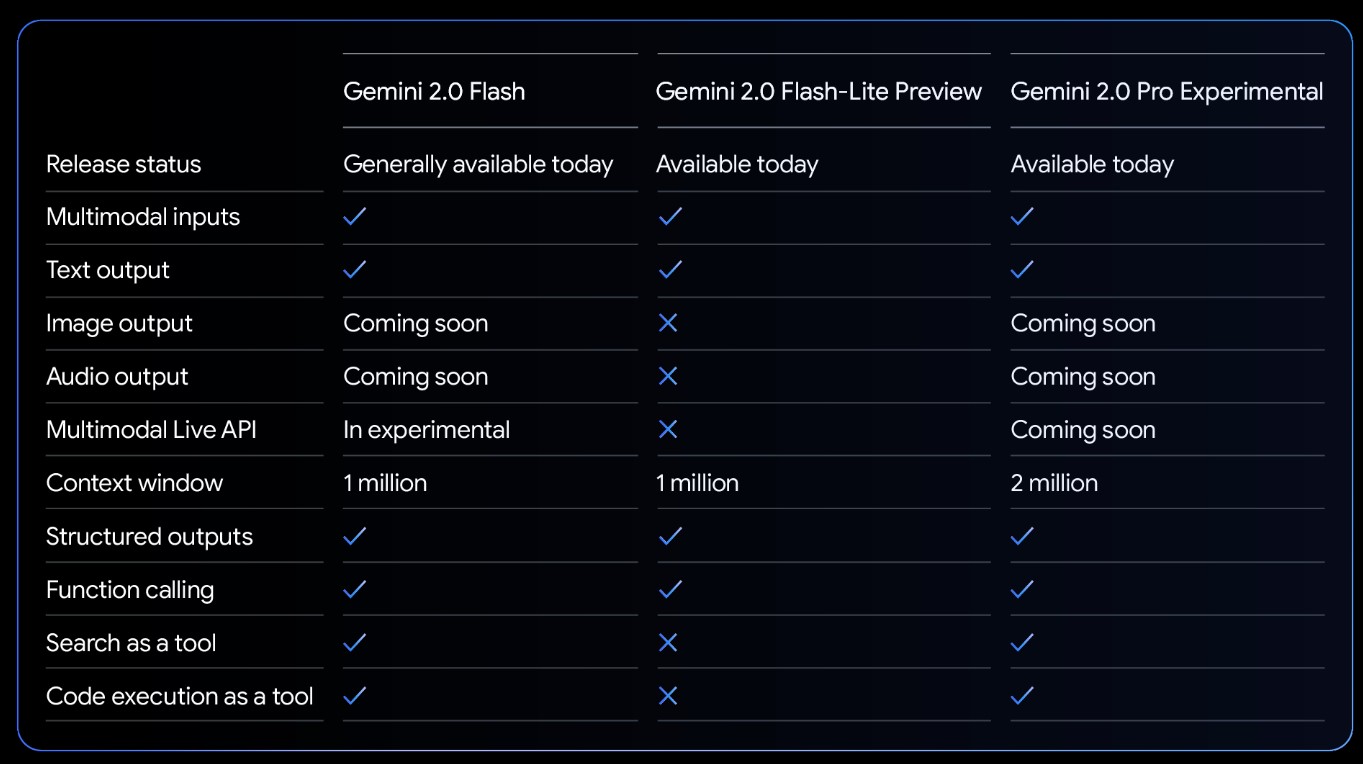

Gemini 2.0 bietet drei Hauptvarianten: Flash, Pro und Flash-Lite, die jeweils auf unterschiedliche Bedürfnisse zugeschnitten sind.

- Gemini 2.0 Flash: Dieses Modell ist ein echtes Arbeitstier. Es eignet sich optimal für Aufgaben, die ein hohes Volumen und eine hohe Frequenz erfordern. Es zeichnet sich durch multimodales Denken über große Informationsmengen mit einem Kontextfenster von 1 Million Tokens aus. Bildgenerierung und Text-to-Speech werden bald folgen.

- Gemini 2.0 Pro: Die experimentelle Version von Gemini 2.0 Pro ist das bisher beste Modell für Coding-Performance und komplexe Prompts. Es verfügt über ein Kontextfenster von 2 Millionen Tokens und die Fähigkeit, Tools wie Google Search und Code Execution zu nutzen. Es hat ein besseres Verständnis und eine bessere Argumentation von Weltwissen als alle bisher veröffentlichten Modelle.

- Gemini 2.0 Flash-Lite: Das Modell ist auf Kosteneffizienz optimiert, ohne dabei die Qualität zu vernachlässigen. Es bietet eine bessere Qualität als Gemini 1.5 Flash bei gleicher Geschwindigkeit und zu gleichen Kosten und übertrifft Gemini 1.5 Flash in den meisten Benchmarks. Es verfügt wie 2.0 Flash über ein Kontextfenster von 1 Million Tokens und multimodale Eingabe.

Für welche Anwendungsfälle sind die einzelnen Modelle am besten geeignet?

- Gemini 2.0 Flash: Eignet sich optimal für Aufgaben, die ein hohes Volumen und eine hohe Frequenz erfordern, beispielsweise die Verarbeitung großer Datenmengen, Chatbots oder Content-Generierung in großem Umfang.

- Gemini 2.0 Pro: Ist ideal für komplexe Coding-Aufgaben, die Analyse großer Codebasen und die Bearbeitung anspruchsvoller Prompts.

- Gemini 2.0 Flash-Lite: Die ideale Wahl, wenn es auf Kosteneffizienz bei der Verarbeitung von Textdaten in großem Umfang ankommt, z. B. für die Generierung von Bildunterschriften oder die Analyse von Textdokumenten. Zum Beispiel kann es eine passende einzeilige Bildunterschrift für rund 40.000 einzigartige Fotos für weniger als einen Dollar im kostenpflichtigen Tarif von Google AI Studio generieren.

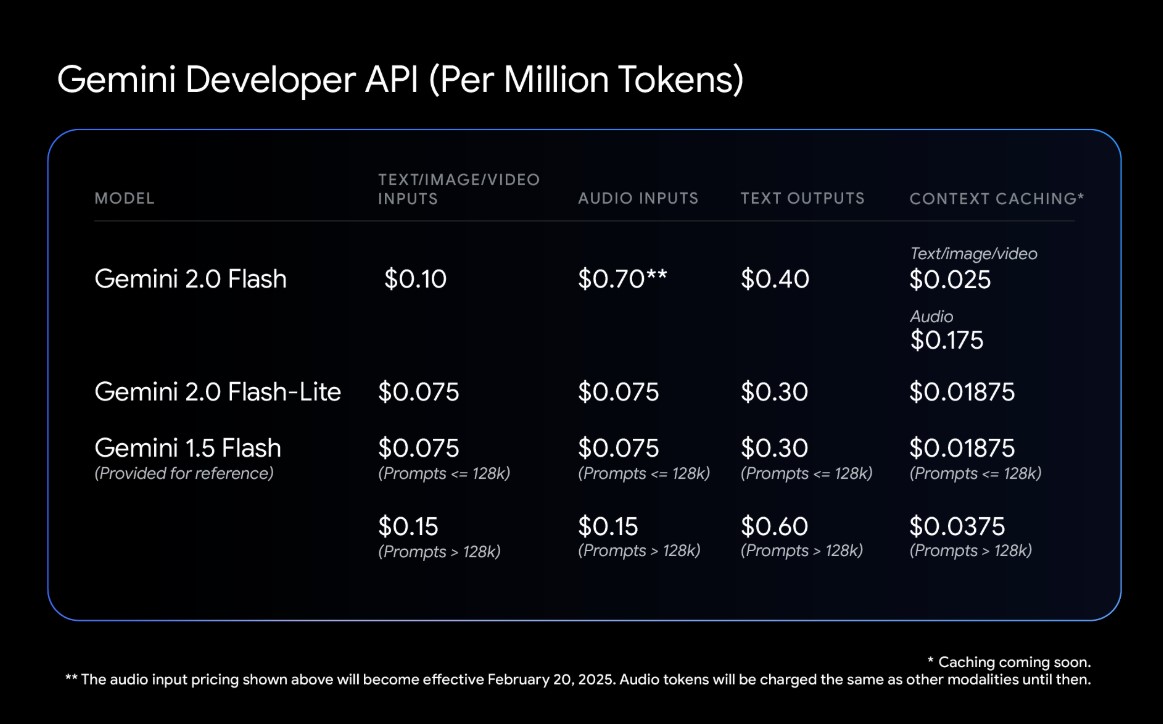

Wie hoch sind die Kosten für die Nutzung der verschiedenen Gemini 2.0 Modelle?

Google hat die Preise für Gemini 2.0 Flash und 2.0 Flash-Lite vereinfacht. Es gibt einen einzigen Preis pro Eingabetyp, wodurch die Unterscheidung zwischen kurzen und langen Kontextanfragen entfällt. Für Workloads mit gemischtem Kontext können die Kosten für 2.0 Flash und Flash-Lite niedriger sein als bei Gemini 1.5 Flash, trotz der Leistungsverbesserungen, die beide bieten. Genaue Details zur Preisgestaltung findest du im Google for Developers Blog.

Welche Verbesserungen bieten die neuen Modelle im Vergleich zu Gemini 1.5?

Gemini 2.0 bietet eine Reihe von Verbesserungen gegenüber Gemini 1.5, darunter:

- Höhere Leistung: Verbesserte Ergebnisse in wichtigen Benchmarks, insbesondere in Bezug auf Coding und das Verständnis komplexer Prompts.

- Größere Kontextfenster: Gemini 2.0 Pro verfügt über ein Kontextfenster von 2 Millionen Tokens, was eine umfassendere Analyse großer Datenmengen ermöglicht.

- Kosteneffizienz: Gemini 2.0 Flash-Lite bietet eine bessere Qualität als Gemini 1.5 Flash bei gleicher Geschwindigkeit und zu gleichen Kosten.

- Vereinfachte Preise: Die Preise für Gemini 2.0 Flash und 2.0 Flash-Lite wurden vereinfacht, was die Kostenverwaltung erleichtert.

Wie kann ich Gemini 2.0 in meine Projekte integrieren?

Du kannst Gemini 2.0 über die Gemini API in Google AI Studio und Vertex AI in deine Projekte integrieren. Google bietet eine benutzerfreundliche Dokumentation und Codebeispiele, die dir den Einstieg erleichtern. Bereits mit wenigen Codezeilen kannst du die Leistungsfähigkeit der Gemini-Modelle nutzen und deine Anwendungen verbessern.

Welche Sicherheitsmaßnahmen wurden implementiert, um die sichere Nutzung von Gemini 2.0 zu gewährleisten?

Google hat umfassende Sicherheitsmaßnahmen implementiert, um die sichere Nutzung von Gemini 2.0 zu gewährleisten. Dazu gehören neue Techniken des bestärkenden Lernens, bei denen Gemini selbst seine Antworten kritisiert, sowie automatisierte Red-Teaming-Prozesse zur Bewertung von Sicherheitsrisiken. Diese Maßnahmen zielen darauf ab, die Fähigkeit des Modells zu verbessern, sensible Prompts zu verarbeiten und Risiken durch indirekte Prompt-Injektion zu minimieren.

Welche zukünftigen Entwicklungen und Updates sind für die Gemini 2.0 Familie geplant?

Google arbeitet kontinuierlich an weiteren Updates und verbesserten Funktionen für die Gemini 2.0 Modellfamilie. Zukünftig sollen weitere Modalitäten wie Bild- und Audioausgabe allgemein verfügbar sein. Außerdem wird an der Optimierung der Modelle in Bezug auf Leistung, Effizienz und Sicherheit gearbeitet.

Wie kann ich das Modell dazu bringen, einen ausführlicheren Schreibstil zu verwenden?

Gemini 2.0 Flash verwendet standardmäßig einen prägnanten Stil, um die Nutzung zu vereinfachen und Kosten zu senken. Du kannst es jedoch anweisen, einen ausführlicheren Stil zu verwenden, der in Chat-orientierten Anwendungsfällen bessere Ergebnisse liefert. Experimentiere mit verschiedenen Prompts und Anweisungen, um den gewünschten Schreibstil und die gewünschte Textlänge zu erzielen.

Abschnitt: Konkrete Tipps und Anleitungen

- Nutze die Gemini API: Integriere Gemini 2.0 in deine Anwendungen über die Gemini API in Google AI Studio und Vertex AI.

- Experimentiere mit verschiedenen Modellen: Wähle das passende Modell (Flash, Pro oder Flash-Lite) entsprechend deinen Anforderungen und deinem Budget aus.

- Optimiere deine Prompts: Verwende klare und präzise Prompts, um die besten Ergebnisse zu erzielen.

- Berücksichtige die Kosten: Achte auf die Preisgestaltung der verschiedenen Modelle und optimiere deine Nutzung, um Kosten zu sparen.

- Bleibe auf dem Laufenden: Informiere dich regelmäßig über neue Updates und Funktionen der Gemini 2.0 Familie.

Regelmäßige Aktualisierung

Dieser Artikel wird regelmäßig aktualisiert, um die neuesten Entwicklungen und Funktionen von Gemini 2.0 zu berücksichtigen und dir stets aktuelle Informationen zu bieten.

Fazit: Gemini 2.0 – Ein großer Schritt vorwärts für die KI-Modellentwicklung

Mit der Einführung von Gemini 2.0 hat Google einen bedeutenden Schritt nach vorn in der Entwicklung von KI-Modellen gemacht. Die Modelle Flash, Pro und Flash-Lite bieten Entwicklern und Anwendern eine breite Palette an Möglichkeiten, von der effizienten Verarbeitung großer Datenmengen bis hin zur Lösung komplexer Coding-Aufgaben. Die verbesserten Kontextfenster, die optimierte Leistung und die vereinfachte Preisgestaltung machen Gemini 2.0 zu einer attraktiven Option für eine Vielzahl von Anwendungsfällen.

Besonders hervorzuheben ist die kontinuierliche Arbeit von Google an der Sicherheit und Zuverlässigkeit der Modelle. Die implementierten Sicherheitsmaßnahmen tragen dazu bei, Risiken zu minimieren und eine verantwortungsvolle Nutzung der KI-Technologie zu gewährleisten. Die zukünftigen Entwicklungen und Updates der Gemini 2.0 Familie versprechen weitere spannende Innovationen und Verbesserungen.

Die neuen Modelle bieten eine hohe Flexibilität und ermöglichen es dir, das passende Modell für deine spezifischen Bedürfnisse auszuwählen. Egal, ob du ein kosteneffizientes Modell für die Verarbeitung großer Textmengen, ein leistungsstarkes Modell für komplexe Coding-Aufgaben oder ein Allround-Modell für verschiedene Anwendungen suchst, Gemini 2.0 hat für jeden etwas zu bieten.

Insgesamt stellt Gemini 2.0 eine vielversprechende Weiterentwicklung im Bereich der KI dar. Die Modelle bieten nicht nur eine verbesserte Leistung und Effizienz, sondern auch eine größere Flexibilität und Anpassungsfähigkeit. Es bleibt spannend zu sehen, wie Entwickler und Unternehmen die neuen Möglichkeiten nutzen werden, um innovative Anwendungen und Lösungen zu entwickeln. Nutze die Chance und tauche ein in die Welt von Gemini 2.0, um das volle Potenzial dieser fortschrittlichen KI-Technologie auszuschöpfen.

www.KINEWS24-academy.de – KI. Direkt. Verständlich. Anwendbar. Hier kannst Du Dich in einer aktiven Community austauschen und KI lernen.

Quellen

- Google DeepMind Blog: https://blog.google/technology/google-deepmind/gemini-model-updates-february-2025

- Google for Developers Blog: https://developers.googleblog.com/en/gemini-2-family-expands

#AI #KI #ArtificialIntelligence #KuenstlicheIntelligenz #Gemini2 #GoogleAI #DeepMind #LLM

Über den Autor

Ich bin Oliver Welling, 57, und beschäftige mich mit Chatbots, seit ich ELIZA 1987 zum ersten Mal erlebt habe. Seit knapp zwei Jahren arbeite ich an den KINEWS24.de – jeden Tag gibt es die neuesten News und die besten KI-Tools – und eben auch: Jede Menge AI-Science. KI erlebe ich als Erweiterung meiner Fähigkeiten und versuche, mein Wissen zu teilen.

Ich war sehr lange skeptisch mit Google. Erst kam Bard – und als ChatGPT User war das ein gefühlter Google-Fehlschlag. Ich konnte nicht verstehen, wieso der Konzern, der die allermeisten Daten auf dieser Welt hat, ein so schlechtes Modell bauen konnte – und auch noch meinte, dass es benutzbar sein. Mit weiteren Iterationen fand ich das Modell immer nur minimal besser. Gemini war dann plötzlich besser. Ich weiss nicht mehr genau, wann es so weit war – plötzlich war das Ai-Studio von Google bei mir immer in einem Tab geöffnet – und Google Gemini wurde zu einem täglichen Begleiter.

Mit Google Gemini 2.0 Flash Thinking komme ich so langsam an die Grenze: Brauche ich meine ChatGPT-Subscription überhaupt noch? Auch die Integration – ziemlich gut gelöst und gefühlt nahtlos – in meinen Google Workspace funktioniert meistens wirklich prima.

Ich bin fast sicher, dass Google es in diesem Jahr noch schaffen wird OpenAI zu überholen. Spätestens mit Gemini 3.0 – wir werden es Live erleben und mit Euch teilen 🙂