Enthüllt durch Dialog: Wie TalkToModel maschinelles Lernen für jedermann zugänglich macht

Obwohl maschinelles Lernen unseren Alltag bereits durchdringt, bleiben die Vorhersagen selbstlernender Modelle für die meisten Laien ein Buch mit sieben Siegeln. Zu komplex scheinen die internen Prozesse tiefer neuronaler Netze oder Support Vector Machines. Bisher scheiterten Ansätze zur besseren Erklärbarkeit häufig daran, dass zur Interpretation der Ergebnisse Expertenwissen erforderlich war.

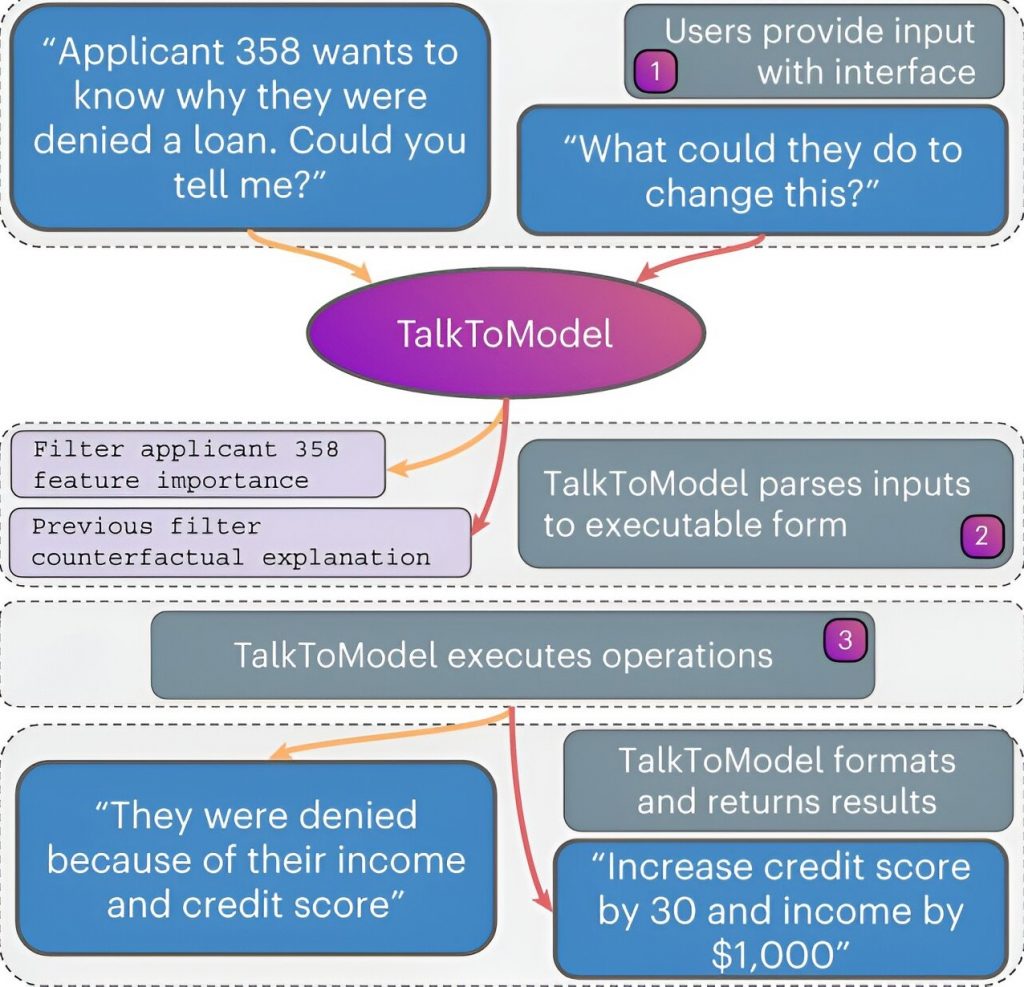

Ein Forschungsteam am Caltech entwickelte nun mit TalkToModel ein System, das diesen Missstand beheben könnte. Ihr cleverer Ansatz: Komplexe Zusammenhänge auf einfache Weise durch natürliche Konversation zu vermitteln. Dabei kombinieren sie drei zentrale Komponenten:

Eine Dialog-Engine, die durch tiefes Sprachverständnis selbst komplexe Anfragen in verständliche Ausgaben übersetzen kann. Eine Bibliothek etablierter Erklärungsmethoden, auf die die Engine zurückgreifen kann. Und eine benutzerfreundliche Schnittstelle, die einen fließenden Informationsaustausch in Form eines Dialogs ermöglicht.

Nutzer können TalkToModel wie einen Experten konsultieren und ganz normal nach den Gründen fragmerkmalsbasierter Vorhersagen, dem Einfluss veränderter Eingabedaten oder allgemeinen Modellinformationen. Anstatt mit mathematischen Formeln oder Visualisierungen konfrontiert zu werden, erhalten sie einfache, anschauliche natürliche Sprach-Erklärungen.

Erste Tests zeigen dabei bereits jetzt, dass dieses Vorgehen Maschinellem Lernen endlich auch für Laien ohne technischen Hintergrund zugänglich macht. Durch die kontextsensible konversationsbasierte Aufbereichung könnte TalkToModel somit die Blackbox komplexer Systeme endgültig öffnen.

Die Blackbox maschinellen Lernens

Tiefe neuronale Netze gelten in Bereichen wie Medizin oder Justiz inzwischen als unverzichtbar. Ihre Fähigkeit, aus riesigen Datenmengen versteckte Muster zu destillieren, ermöglicht hochpräzise Diagnosen oder Risikobewertungen.

Doch je effektiver solche Modelle werden, desto rätselhafter erscheinen ihre Entscheidungsprozesse. Anwender vermögen nicht mehr nachzuvollziehen, warum bestimmte Prognosen getroffen werden. Vertrauen leidet, Anwendungsszenarien werden abgelehnt.

Bisherige Lösungsansätze wie erklärende Bäume sind für Laien schwer verständlich. Andere Methoden erfordern Expertenwissen zur Auswahl und Interpretation komplexer Visualisierungen. Ein einfach zugängliches Werkzeug für jedermann fehlte – bis TalkToModel dieses Manko behebt.

Funktionsweise und Evaluierung

Herzstück ist eine adaptierbare Dialog-Engine, die Anfragen analysiert und passende Module auswählt. Diese berechnen lokale Modellerklärungen oder vergleichen Szenarien, um fundierte Statements zu generieren.

In Tests äußerten über 70% der Nutzer, TalkToModel sei einfacher zu verwenden als andere Methoden. Studierende und Fachleute schätzten die interaktive Vermittlung.

So ebnet das System den Weg, um selbst lernerfüllte Modelle für breite Anwenderkreise verständlich und vertrauenswürdig zu machen. Langfristig könnte es die Implementation komplexer KI in kritischen Bereichen erleichtern.

TalkToModel bringt Licht ins Dunkel

Hier setzt TalkToModel an. Das System des Caltech ermöglicht es erstmals, ML-Modelle durch natürliche Konversation zu befragen. Dazu kombiniert es drei Schlüsselkomponenten:

- Eine Dialog-Engine, die Anfragen in verständliche Ausgaben übersetzt.

- Eine Ausführungseinheit mit etablierten Erklärungsmethoden wie LIME oder Anchors.

- Eine benutzerfreundliche Schnittstelle für den Dialog.

Nutzer können das System wie einen Experten konsultieren. Ob wichtige Merkmale, Einfluss veränderter Daten oder allgemeine Modellinformationen – TalkToModel erklärt fundiert und interaktiv.

Dabei bleibt seine Terminologie einfach, ohne Fachjargon. Auch komplexe Zusammenhänge werden anschaulich dargestellt. Tests bestätigen die einzigartige Verständlichkeit: Über 70% der Teilnehmer bevorzugten TalkToModel gegenüber herkömmlichen Erklärungsformaten.

TalkToModel ebnet den Weg für einen breiteren Einsatz von KI

Durch seine Fähigkeit maschinelles Lernen einfach zugänglich zu machen, könnte TalkToModel weitreichende Folgen haben:

Für die Wirtschaft bedeutet es, KI-gestützte Anwendungen und Dienste nun auch für weniger versierte Nutzergruppen verfügbar zu machen. So ließen sich neue Anwendungsszenarien und Märkte erschließen.

Auch regulatorische Akzeptanz dürfte steigen, wenn sich Politiker und Aufsichtsbehörden selbst ein Bild von den zugrundeliegenden Modellen machen können. So wäre der Weg frei für einen breiteren Einsatz von KI in sensiblen Bereichen wie Medizin oder Finanzen.

Mittelfristig besteht die Möglichkeit, TalkToModel in bestehende Systeme wie Chatbots oder Entscheidungshilfen zu integrieren. Nutzer könnten jederzeit einen Blick hinter die Kulissen werfen und Vertrauen in automatisierte Prozesse aufbauen.

Langfristig könnte natürliche Konversation eine Schlüsselrolle für das Verständnis immer komplexerer KI-Systeme einnehmen. Forschungsteams erhielten ein Werkzeug, um Laien Einblicke in neuartige Modellklassen zu ermöglichen.

Sollten Dialogsysteme wie TalkToModel die Akzeptanz selbstlernender Systeme nachhaltig steigern, würde dies die Entwicklung einer vertrauensvollen und nutzerorientierten KI-Zukunft maßgeblich vorantreiben. Der Dialog als Erklärungsmethode könnte zur neuen Norm avancieren.

Fazit: Ein Dialog entschlüsselt die Blackbox

TalkToModel beweist, wie einfach Maschinenlernen durch natürliche Interaktion vermittelt werden kann. Durch offene Dialoge erfahren Nutzer spielerisch, was normalerweise unsichtbar bleibt.

Das System überwindet Barrieren, die der Anwendung selbst lernerfüllter Modelle bisher im Wege standen. Durch kontextsensible Erklärungen schafft es Vertrauen in Prognosen, deren Hintergründe vorher undurchdringlich schienen.

Wer KI verständlich machen will, kommt an TalkToModel womöglich nicht vorbei. Sein Ansatz könnte Wege aufzeigen, um Algorithmmen fassbar zu machen – mithilfe eines einzigen Werkzeugs, das Unwissen abbaut: dem Dialog.

Quelle: Nature machine intelligence, Techxplore

#NatürlicheSprache #MaschinellesLernen #Erklärbarkeit #Modellverständnis #Dialogsystem #Mensch-Maschine-Interaktion #KI-Anwendung #TalkToModel #XAI #ki #ai #kuenstlicheintelligenz #künstlicheintelligenz

Die 10 besten Alternativen zu ChatGPT findest Du hier!