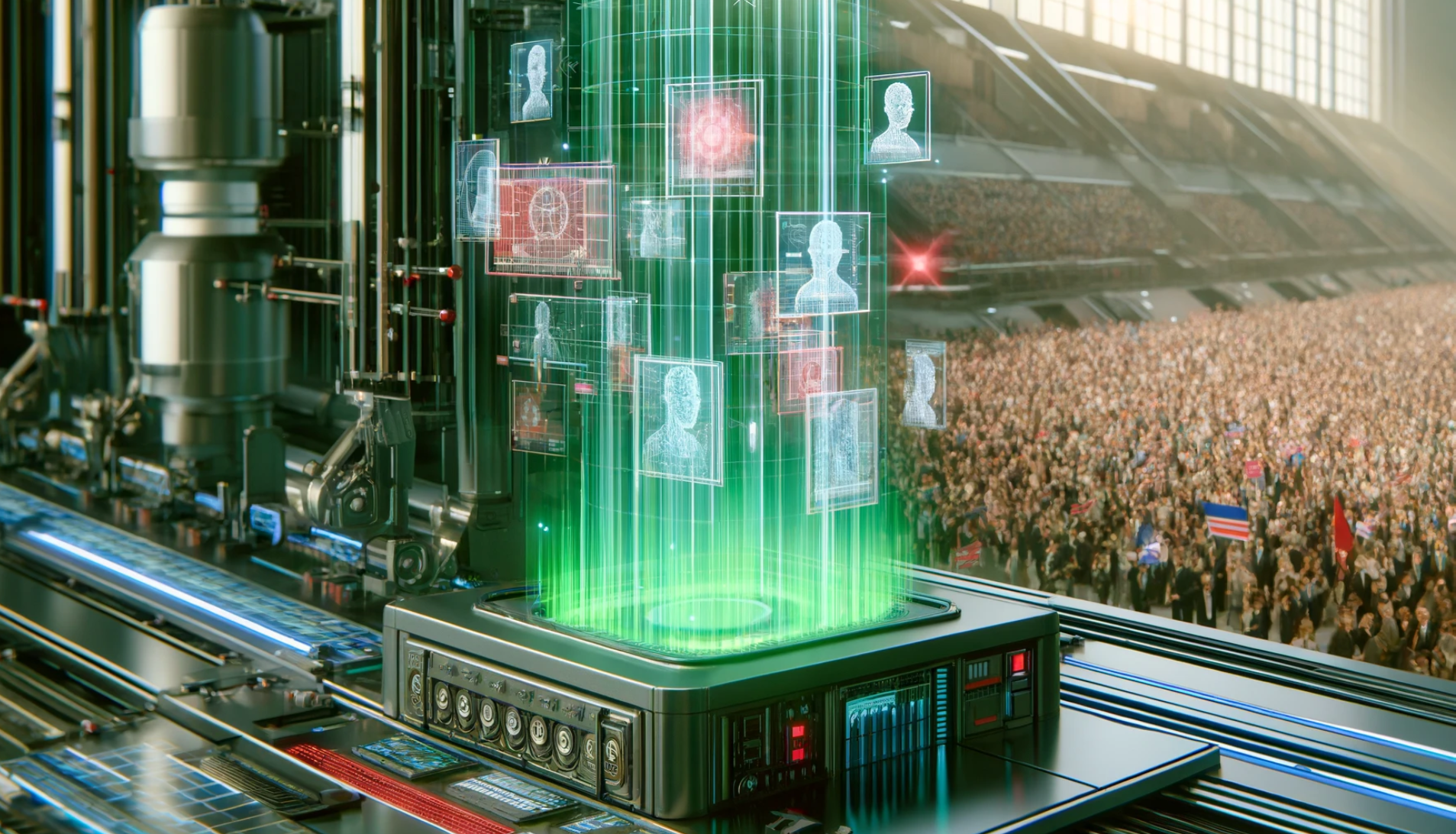

OpenAI KI-Detektor: Das US-amerikanische KI-Unternehmen OpenAI hat ein Tool vorgestellt, das Bilder erkennen kann, die von seinem eigenen Text-zu-Bild-Generator DALL-E 3 erstellt wurden. Die Ankündigung erfolgte am Dienstag vor dem Hintergrund wachsender Sorgen über den Einfluss von KI-generierten Inhalten auf die diesjährigen Wahlen weltweit. Das Tool soll laut internen Tests in 98% der Fälle korrekt identifizieren, ob ein Bild von DALL-E 3 stammt. Auch gängige Bildmanipulationen wie Komprimierung, Zuschneiden oder Sättigungsänderungen beeinträchtigen die Erkennungsleistung nur minimal.

Das musst Du wissen – OpenAI KI-Detektor

- OpenAI lanciert Tool zur Erkennung von DALL-E 3 generierten Bildern

- 98% Erkennungsgenauigkeit in internen Tests

- Robust gegenüber gängigen Bildmanipulationen

- Geplant: Fälschungssichere Wasserzeichen für digitale Inhalte

- OpenAI tritt Branchengruppe mit Google, Microsoft und Adobe bei

- Ziel: Standard zur Rückverfolgung des Ursprungs verschiedener Medien

- Bedenken wegen Einfluss von KI-Inhalten auf Wahlen weltweit

- OpenAI und Microsoft starten $2 Mio. Fonds für “gesellschaftliche Resilienz” und KI-Bildung

Der Schritt kommt zu einer Zeit, in der die Verbreitung von KI-generierten Inhalten und Deepfakes bei Wahlen weltweit zunimmt. In Indien kursierten während der laufenden Parlamentswahlen gefälschte Videos von zwei Bollywood-Schauspielern, die Premierminister Narendra Modi kritisieren. Auch in den USA, Pakistan und Indonesien spielen KI-Inhalte eine wachsende Rolle.

Um dem entgegenzuwirken, plant OpenAI zusätzlich die Einführung fälschungssicherer Wasserzeichen. Diese sollen digitale Inhalte wie Fotos oder Audiodateien mit einem nur schwer entfernbaren Signal markieren. Dazu ist das Unternehmen einer Branchengruppe beigetreten, der auch Google, Microsoft und Adobe angehören. Gemeinsam wollen sie einen Standard entwickeln, der dabei hilft, den Ursprung verschiedener Medien zurückzuverfolgen.

Zusätzlich kündigte OpenAI an, gemeinsam mit Microsoft einen $2 Millionen “Societal Resilience” Fonds ins Leben zu rufen. Dieser soll die Bildung im Bereich Künstliche Intelligenz unterstützen und so die Widerstandsfähigkeit der Gesellschaft gegenüber KI-Risiken stärken.

Fazit OpenAI KI-Detektor: Ein wichtiger Schritt für mehr Transparenz und Sicherheit

OpenAI KI-Detektor: Das neue Erkennungstool von OpenAI ist ein bedeutender Fortschritt im Kampf gegen die Verbreitung von KI-generierten Fake News und Deepfakes. Mit seiner hohen Genauigkeit und Robustheit gegenüber gängigen Manipulationen setzt es neue Maßstäbe. Die geplante Einführung fälschungssicherer Wasserzeichen und die Entwicklung eines branchenweiten Standards zur Ursprungsverfolgung von Medien sind weitere wichtige Schritte in die richtige Richtung.

Dennoch bleiben Herausforderungen. Die rasante Entwicklung der KI-Technologie erfordert kontinuierliche Anpassungen und Verbesserungen der Erkennungstools. Auch müssen rechtliche und ethische Fragen geklärt werden, etwa zum Umgang mit KI-generierten Inhalten in politischen Kampagnen oder zum Schutz der Persönlichkeitsrechte.

Insgesamt ist OpenAIs Initiative jedoch ein positives Signal. Sie zeigt, dass führende KI-Unternehmen die Risiken ernst nehmen und aktiv an Lösungen arbeiten. In Kombination mit Bildungsmaßnahmen und gesellschaftlichem Dialog kann so das Vertrauen in KI-Systeme gestärkt und ihre Vorteile verantwortungsvoll genutzt werden.

#KI #AI #ArtificialIntelligence #OpenAI #DALLE3