Die Entwickler von Stable Diffusion 3 (SD3) haben heute ihr Forschungspapier veröffentlicht, das tiefe Einblicke in die Technologie hinter ihrem neuesten KI-System gibt. Die Ergebnisse sind beeindruckend und zeigen, welches Potenzial in der Generierung photorealistischer Bilder aus Textbeschreibungen steckt.

Stable Diffusion 3 übertrifft Konkurrenz in Nutzerstudien

Diffusionsmodelle sind ein spannendes Thema in der Welt der KI. Sie sind darauf trainiert, Daten in zufälligen Geräuschen umzukehren, was sie ideal für die Erzeugung neuer Datenpunkte macht. Diese Technik hat sich als besonders effektiv für die Modellierung von hochdimensionalen, wahrnehmungsbezogenen Daten wie Bildern erwiesen.

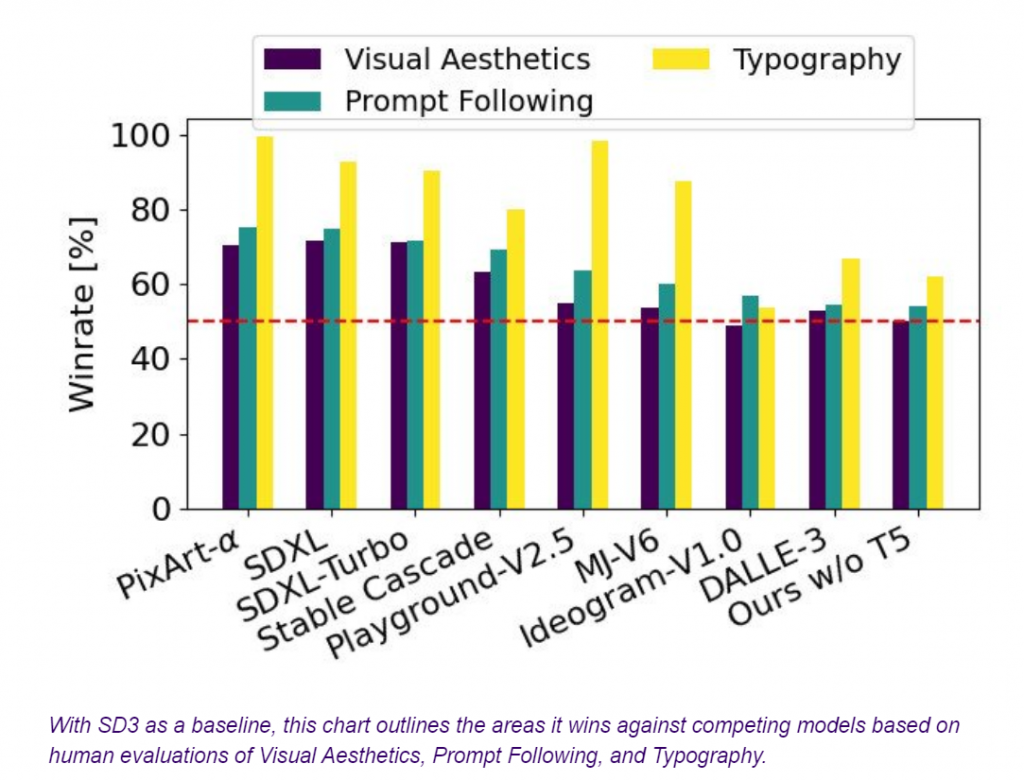

In Vergleichstests mit anderen state-of-the-art Systemen wie DALL·E 3, Midjourney v6 und Ideogram v1 ging Stable Diffusion 3 als klarer Sieger hervor. Menschliche Tester bewerteten die von SD3 generierten Bilder in puncto visuelle Ästhetik, Umsetzung der Textbeschreibung und Darstellung von Schrift als überlegen.

Stability AI hat Ausgabebilder von Stable Diffusion 3 mit verschiedenen anderen offenen Modellen, einschließlich SDXL, SDXL Turbo, Stable Cascade, Playground v2.5 und Pixart-α, sowie geschlossenen Systemen wie DALL·E 3, Midjourney v6 und Ideogram v1 verglichen, um die Leistung basierend auf menschlichem Feedback zu bewerten. Während dieser Tests wurden menschliche Evaluatoren mit Beispieloutputs aus jedem Modell versorgt und gebeten, die besten Ergebnisse auszuwählen, basierend darauf, wie genau die Modellausgaben dem Kontext der gegebenen Aufforderung folgten (“Prompt-Folgen”), wie gut Text basierend auf der Aufforderung gerendert wurde (“Typografie”) und welches Bild eine höhere ästhetische Qualität aufweist (“visuelle Ästhetik”).

Aus den Ergebnissen dieser Tests hat Stability AI festgestellt, dass Stable Diffusion 3 den aktuellen State-of-the-Art Text-zu-Bild-Generierungssystemen in allen oben genannten Bereichen ebenbürtig ist oder sie übertrifft.

In frühen, unoptimierten Inferenztests auf Verbraucherhardware passt das größte SD3-Modell von Stability AI mit 8B Parametern in den 24GB VRAM einer RTX 4090 und benötigt 34 Sekunden, um ein Bild mit einer Auflösung von 1024×1024 zu generieren, wenn 50 Sampling-Schritte verwendet werden. Zusätzlich wird es bei der Erstveröffentlichung mehrere Variationen von Stable Diffusion 3 geben, die von 800M bis zu 8B Parametermodellen reichen, um Hardwarebarrieren weiter zu verringern.

MMDiT-Architektur: Der Schlüssel zum Erfolg

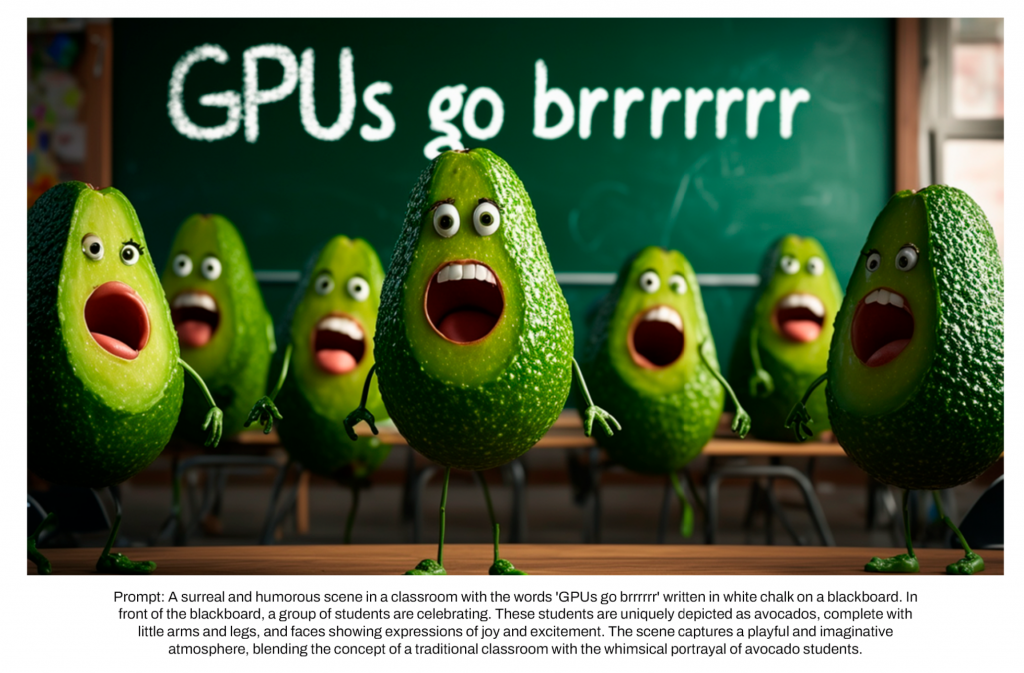

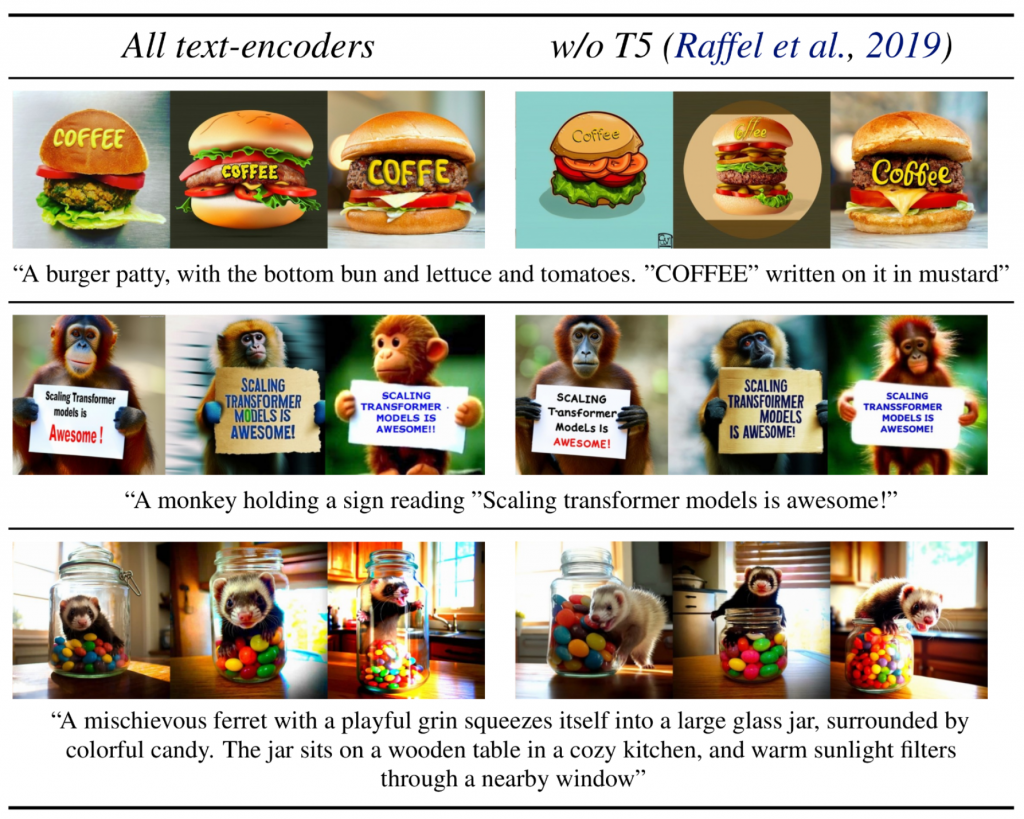

Das Herzstück von Stable Diffusion 3 ist die neu entwickelte Multimodal Diffusion Transformer (MMDiT) Architektur. Sie verarbeitet Bild- und Textinformationen in getrennten Bereichen des neuronalen Netzes, lässt aber einen bidirektionalen Informationsfluss zwischen ihnen zu.

Dadurch wird das Textverständnis und die Fähigkeit, Schrift präzise darzustellen, enorm verbessert. MMDiT übertrifft etablierte Ansätze wie UViT und DiT deutlich, was visuelle Qualität und Texttreue angeht.

Rectified Flow: Effizienter und skalierbarer

SD3 setzt auf den Rectified Flow (RF) Ansatz, bei dem Daten und Rauschen während des Trainings linear verbunden werden. Das resultiert in geraderen Pfaden bei der Bilderzeugung, was eine schnellere Generierung mit weniger Rechenschritten ermöglicht.

Durch eine neuartige Gewichtung der Trainingspfade, die den mittleren Bereichen mehr Bedeutung zumisst, konnte die Leistung von RF noch weiter gesteigert werden. In Tests mit 60 anderen Verfahren wie LDM, EDM und ADM zeigte der optimierte RF-Ansatz durchgehend die besten Ergebnisse.

Stable Diffusion 3 (SD3) sticht hervor, wenn es um die Generierung von hochauflösenden Bildern geht. Mit einer Bildauflösung von 1024×1024 und einer Generierungszeit von nur 34 Sekunden auf einer RTX 4090 ist dieses Modell bemerkenswert effizient

Fazit Stable Diffusion 3 Studie

Die Forschungsergebnisse zu Stable Diffusion 3 demonstrieren eindrucksvoll die rasanten Fortschritte im Bereich der Text-zu-Bild-Generierung durch KI. Mit der innovativen MMDiT-Architektur und dem optimierten Rectified Flow Training setzt SD3 neue Maßstäbe in Sachen Qualität, Detailtreue und Geschwindigkeit.

Skalierungstests zeigen, dass die Leistung mit zunehmender Modellgröße weiter steigt – ohne Anzeichen einer Sättigung. Es bleibt spannend zu sehen, welche kreativen Anwendungen diese Technologie in Zukunft ermöglichen wird. Von photorealistischen Illustrationen über künstlerische Konzepte bis hin zu maßgeschneiderten Designs – der Fantasie sind keine Grenzen gesetzt.

Quelle: Stability AI, Studien-Paper-PDF

#KuenstlicheIntelligenz #artificialintelligence #KI #AI #Bildgenerierung #Kreativität #Zukunftstechnologie #SD3 #StabilityAI